راهنمای کامل مدل ۴ فازی ICAM:

مدیریت هوشمندانه هوش مصنوعی

برای فرار از دام سوگیریهای جهانی

در کسبوکارهای ایرانی

هوش مصنوعی (Artificial Intelligence)

چیست؟

هوش مصنوعی (AI) به طور مرجع، عبارت است از علم و مهندسی ساخت سیستمها یا برنامههای رایانهای که قادر به انجام وظایفی هستند که به طور معمول مستلزم هوش انسانی است. این وظایف شامل تواناییهایی مانند یادگیری (کسب اطلاعات و قوانین استفاده از آنها)، استدلال (استفاده از قوانین برای رسیدن به نتایج تقریبی یا قطعی)، حل مسئله، درک زبان طبیعی و تشخیص الگوها میشود. هدف نهایی هوش مصنوعی، ایجاد ماشینهایی است که میتوانند محیط خود را درک کرده و برای به حداکثر رساندن شانس موفقیت در دستیابی به هدف، اقدامات خود را منطقیسازی کنند.

چرا هوش مصنوعی در محیط کسبوکار

ایران شکست میخورد؟

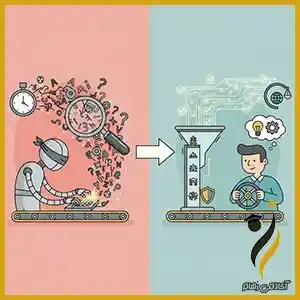

تصور عمومی بر این است که استفاده از ابزارهای هوش مصنوعی (AI) مانند مدلهای زبانی بزرگ (LLM)، تضمینکننده بهرهوری و دقت در تحلیلهای سازمانی است. اما حقیقت این است که بسیاری از کسبوکارهای ایرانی، با وجود سرمایهگذاری زمانی و مالی قابل توجه، خروجیهای غیرکاربردی و بیاثر دریافت میکنند. ریشه این شکست در خود مُدلها نیست، بلکه در ناهمخوانی ساختاری میان جهان فکری AI و واقعیتهای بومی ایران قرار دارد. هوش مصنوعی که محصول دادهها، قوانین و فرهنگهای عمدتاً غربی است، توانایی درک و پردازش موانع خاص بازار ایران را ندارد. وقتی مدیر یا کارمندی یک راهحل استراتژیک از GPT میخواهد، پاسخی آکادمیک و جذاب دریافت میکند که در عمل، با اولین برخورد به موانعی چون قوانین کار خاص، چالشهای تحریمی، نوسانات ارزی یا ملاحظات فرهنگی مصرفکننده، فرو میریزد. این گسست، سازمان را از مسیر تصمیمگیری دقیق منحرف کرده و اتکای بیرویه به فناوری را به یک ریسک عملیاتی جدی تبدیل میکند. برای موفقیت، باید فراتر از قابلیتهای پردازشی AI، به مدیریت انتقادی و تطبیق ساختاری آن فکر کنیم. محققان در این مطالعه، پنج مدل پرکاربرد زبان بزرگ شرکت اوپنایآی، شامل GPT4o ،GPT-4-turbo GPT-4 ،GPT-3.5-turbo و GPT-3 را ارزیابی کردند. معیار سنجش این پژوهش، دادههای «پیمایش جهانی ارزشها» یا World Values Survey بود تا پاسخهای مدلها به مقایسه با ارزشهای فرهنگی واقعیِ کشورهای مختلف پرداخته شود. نتایج به وضوح نشان داد که تمامی مُدلهای مورد آزمایش، بهطور پیشفرض، دارای یک سوگیری فرهنگی غربی هستند. ارزشهای منعکس شده در خروجی این مدلها شباهت زیادی به ارزشهای فرهنگیِ متداول در کشورهای انگلیسیزبان و پروتستان اروپایی دارد. این یافتهها، که با نمایش بر روی نقشه فرهنگی جهانی اینگلهارت-ولزِل تأیید شدهاند، نگرانیها را در مورد نادیده گرفته شدن یا تحریف شدن بیان اصیل فرهنگی در سایر جوامع افزایش میدهد.

شکاف پنهان: معرفی سوگیری فرهنگی AI

شکست هوش مصنوعی در محیط ایران، نه یک اتفاق، بلکه نتیجه اجتنابناپذیر یک سوگیری (Bias) ساختاری است که در عمق دادههای آموزشی آن ریشه دارد. مدلهای زبانی بزرگ با انبوهی از متون و دادههای تولید شده در اکوسیستمهای حقوقی، اقتصادی و فرهنگی غرب تغذیه شدهاند. این غلبه دادهای، به صورت ناخودآگاه، یک «جهانبینی» خاص را در مدلها نهادینه میکند. همانطور که پژوهشهای آکادمیک در دانشگاههایی نظیر هاروارد نشان میدهند، سیستم ارزشی AI به طور معناداری به سمت ارزشهای سکولار و فردگرایانه جوامع غربی تمایل دارد. این یعنی، زمانی که AI به تحلیل بازار، قوانین یا استراتژیهای رشد میپردازد، چارچوب فکری خود را بر مبنای ثبات اقتصادی، دسترسی کامل به ابزارهای جهانی و چارچوبهای قانونی اروپایی یا آمریکایی قرار میدهد. در نتیجه، برای یک کسبوکار ایرانی، یک استراتژی بازاریابی که نیاز به پلتفرمهای فیلتر شده یا یک طرح مالی که تأثیر تورم لجامگسیخته را نادیده میگیرد، عملاً بیاعتبار و ناکارآمد خواهد بود. این «شکاف پنهان»، جایی است که هوش مصنوعی جهانی با واقعیتهای محلی ایران برخورد میکند.

تله اعتماد کورکورانه: سناریوی KPI

و داشبوردهای بیخاصیت

یکی از ملموسترین نمونههای شکست هوش مصنوعی، در فرآیند تعریف شاخصهای عملکرد کلیدی (KPI) برای داشبوردهای مدیریتی خود را نشان میدهد. تصور کنید مدیرعامل از مدیر مارکتینگ میخواهد تا داشبوردی طراحی کند که دیدگاهی استراتژیک از وضعیت بازار به او بدهد. مدیر مارکتینگ، این وظیفه را به تیم خود محول میکند و اعضا به سادگی از GPT میخواهند تا «بهترین KPIها» را برایشان لیست کند. نتیجه، فهرستی بلندبالا از شاخصهای جذاب و علمی است؛ مانند اندازهگیری دقیق Customer Lifetime Value (CLV) یا نرخ تعامل در شبکههای اجتماعی بینالمللی. اینجاست که تله اعتماد کورکورانه فعال میشود. اعضای تیم، به دلیل اعتبار ظاهری GPT، این خروجیها را بدون فیلتر و تحلیل عمیق به عنوان «صحیح و کامل» میپذیرند. در حالی که این KPIها، اساساً با واقعیت اقتصادی ایران ناهمخوان هستند؛ برای مثال، مدل CLV در شرایط تورم بالا و نوسانات ارزی که قیمتگذاریهای بلندمدت را تقریباً غیرممکن میکند، عملاً غیرقابل محاسبه و بیمعنی است. همچنین تمرکز بر پلتفرمهای فیلتر شده، منجر به تولید معیارهای ظاهری (Vanity Metrics) میشود که فقط آمار بالایی نشان میدهند اما هیچ ارتباطی با فروش واقعی یا سودآوری ندارند. در نهایت، داشبورد نهایی با دادههایی پر میشود که برای تصمیمگیری استراتژیک در بازار ایران کاملاً بیفایدهاند و مدیرعامل را از اطلاعات کاربردی محروم میکند.

معرفی مدل ICAM: چارچوب مدیریت

هوشمندانه و تطبیقی هوش مصنوعی

مدل ICAM (Intelligent, Critical, Adaptation, Management) یک چارچوب جامع و چهار فازی برای تعامل مؤثر، امن و مسئولانه با هوش مصنوعی مولد (Generative AI) و مدلهای زبان بزرگ (LLMs) است که توسط آقای دکتر مهدی زارعپور مؤسس مدرسه کسب و کار رُهام طراحی و معرفی شده است. هدف اصلی این مدل، گذار از وابستگی صرف به سرعت تولید محتوا توسط AI به سمت تولید محتوای دقیق، قابل اعتماد و همسو با ارزشهای بومی است. با رشد تصاعدی ابزارهای هوش مصنوعی مانند ChatGPT و Gemini، ریسکهای مرتبط با انتشار اطلاعات نادرست یا Halucination، سوگیریهای فرهنگی و نقض حق چاپ نیز افزایش یافته است. ICAM این چالشها را با تمرکز بر توسعه مهارتهای انتقادی انسانی و فرآیندهای مدیریت محتوا، برطرف میکند. این چارچوب کاربران را نه تنها به مصرفکنندگان محتوای AI، بلکه به مدیران، مربیان و بازبینان هوشمند تبدیل میکند تا خروجی AI از مرحله خام به محتوایی ارزشمند، تخصصی و اخلاقی ارتقا یابد. ICAM مسیری برای نهادینهسازی یک اکوسیستم AI مسئولیتپذیر و تطبیقپذیر در سازمانها و استفاده شخصی ارائه میدهد.

فلسفه مدل: گذار از سرعت به صحت

(From Speed to Accuracy)

فلسفه محوری که مدل ICAM بر پایه آن بنا شده، به چالش کشیدن الگوی فعلی استفاده از هوش مصنوعی مولد است. در حال حاضر، کاربران اغلب بهشدت تحت تأثیر سرعت تولید محتوا توسط مدلهای زبان بزرگ (LLMs) قرار میگیرند و ناخودآگاه، معیار سرعت را بر معیار صحت و دقت ارجح میدانند. این اولویتدهی منجر به پذیرش محتوای خام، غیرقابل اعتماد و گاهی کاملاً نادرست هوش مصنوعی میشود که در نهایت، اعتبار حرفهای، کیفیت تصمیمگیریها و دقت خروجیهای تخصصی را به شدت به خطر میاندازد. گذار از سرعت به صحت در مدل ICAM، بهطور دقیق به معنای تغییر نقش هوش مصنوعی از یک “ابزار تولید پیشنویس سریع” به یک “شریک هوشمند برای تأیید و تطبیق داده” است. این رویکرد تأکید دارد که سرعت اولیه در تولید متن یک مزیت است، اما هرگز جایگزین کیفیت، بافت فرهنگی و اعتبار تخصصی نمیشود. سرعت، نماینده فاز اولیه و غیرانتقادی استفاده از AI است که در آن، متن در عرض چند ثانیه تولید میشود، اما این متن معمولاً فاقد فیلتر فرهنگی، بافت بومی و پشتوانه اعتباری لازم است. در مقابل، صحت که تمرکز اصلی ICAM است، جنبههای سهگانه را شامل میشود؛ صحت اطلاعاتی (مانند عدم وجود توهمزایی یا Halucination) صحت فرهنگی (همسویی کامل با ارزشها و بوم منطقهای) و صحت استراتژیک (اطمینان از همخوانی خروجی با اهداف کلان سازمانی و نیازهای کاربر). مدل ICAM با گنجاندن فازهای انتقادی و تطبیق، کاربر انسانی را وادار میکند تا سرعت ماشین را با فرآیندهای بازبینی، بومیسازی و مدیریت تخصصی ادغام کند. این فلسفه تضمین میکند که خروجی نهایی، محصول ترکیبی از سرعت محاسباتی ماشین و هوشمندی، مسئولیتپذیری و دقت انسانی خواهد بود. با این کار، اعتماد به خروجیهای AI به درستی در جایگاه خود قرار گرفته و از پذیرش کورکورانه جلوگیری میشود.

فاز اول Intelligent یا هوشمندانه:

تعریف و آموزش سواد انتقادی

فاز اول مدل ICAM که تحت عنوان هوشمندانه یا Intelligent شناخته میشود، شالوده تعامل موفق و مسئولانه با هوش مصنوعی را تشکیل میدهد. کانون تمرکز در این مرحله، توسعه و نهادینهسازی سواد انتقادی یا همان Critical Literacy کاربران در مواجهه با محتوای تولید شده توسط مدلهای زبان بزرگ است. این سواد انتقادی فراتر از مهارتهای خواندن و نوشتن ساده و شامل تواناییهای تحلیلی پیچیدهای است که برای درک ماهیت، محدودیتها و پتانسیلهای خروجیهای LLMs حیاتی هستند. در این فاز، کاربران موظف به کسب دانش عمیق در مورد مکانیسمهای اساسی هوش مصنوعی هستند؛ باید درک کنند که مدلهای زبان صرفاً موتورهای پیچیده برای پیشبینی کلمه بعدی در یک دنباله هستند و نه منابع دانش مطلق و بیخطا. این شناخت، به صورت بنیادین، انتظار کاربر را از سرعت مطلق به صحت نسبی تغییر میدهد. همچنین، آموزش در مورد پدیده Halucination (تولید اطلاعات ساختگی) یک اولویت است. کاربران باید قادر باشند تا نشانههای Halucination، مانند ذکر منابع غیرواقعی یا ارقام ساختگی، را به سرعت شناسایی کنند. علاوه بر این، تسلط بر مهندسی فرمان (Prompt Engineering) نیز جزیی از هوشمندی است که شامل توانایی نگارش فرمانهایی است که مدل را به سمت ارائهی منابع، تعریف لحن و بافت فرهنگی مطلوب و اعمال محدودیتها برای پاسخهای دقیقتر هدایت میکند. هدف غایی این فاز، ساختن کاربری هوشیار و فعال است که هرگز خروجی AI را بهعنوان حقیقت نهایی نمیپذیرد، بلکه آن را بهعنوان یک پیشنویس اولیه، مستعد خطا و نیازمند بازبینی تخصصی مینگرد.

فاز دوم Adaptation یا تطبیق:

تولید و اجرای لایه بومیسازی

فاز تطبیق (Adaptation) مدل ICAM، فرآیندی کاملاً ضروری است که خروجی خام و عمومی هوش مصنوعی را با بافتهای فرهنگی، حقوقی، اجتماعی و تخصصی بومی یا محلی همسو میسازد. از آنجایی که مدلهای زبان بزرگ اغلب بر پایه دادههای آموزشی جهانی و عمدتاً غربی ساخته شدهاند، محتوای آنها ممکن است با ارزشها و حساسیتهای منطقهای ناسازگار باشد؛ به همین دلیل، اجرای یک «لایه بومیسازی» بر روی خروجی خام حیاتی است. اصلیترین اقدام در این فاز، تطبیق فرهنگی است. این شامل بازنویسی مثالها، استعارهها و ارجاعات (اعم از تاریخی، مذهبی یا اجتماعی) در متن است تا از مغایرت با ارزشهای مخاطب محلی جلوگیری شود و اطمینان حاصل شود که معنای اصلی پیام بهطور مؤثر و قابل پذیرش در چارچوب بومی منتقل میشود. علاوه بر این، باید به بومیسازی اصطلاحات تخصصی پرداخت؛ یعنی اطمینان از اینکه واژگان و نامگذاریهای فنی در زبان یا صنعت محلی، معادلهای دقیق و استاندارد خود را پیدا کنند. رعایت الزامات حقوقی و انطباق (Compliance) یکی دیگر از وظایف مهم است. متن باید برای مطابقت کامل با قوانین محلی، از جمله مقررات حفظ حریم خصوصی دادهها و مالکیت فکری، بازبینی شود. در نهایت، تعیین هویت صدای سازمان (Tone of Voice) نیز ضروری است؛ تنظیم خروجی AI به نحوی که لحن و سبک منحصربهفرد برند یا سازمان را منعکس کند، نه آن لحن عمومی و خنثی. LLMs این فاز اطمینان میدهد که خروجی AI از صرفاً قابل درک بودن به قابل قبول، مرتبط و مؤثر بودن در محیط هدف ارتقا مییابد.

فاز سوم Critical یا انتقادی:

تأیید و تحلیل فراتر از متن

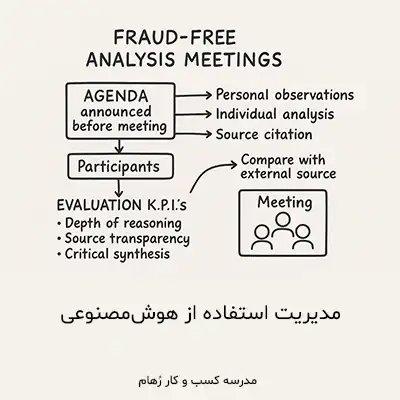

فاز انتقادی (Critical)، قلب تپنده و عنصر متمایز کننده مدل ICAM است و نقش کاربر انسانی را از یک مصرفکننده محتوا به یک تحلیلگر، بازبین متخصص و تأییدکننده نهایی تغییر میدهد. هدف این فاز، اجرای یک تأیید صحت عمیق و چندبعدی است که بسیار فراتر از یک بازخوانی سادهی محتوای AI است و به تحلیل ریشهها و پیامدهای متن میپردازد. اجرای این فاز بر دو ستون اصلی استوار است. ستون اول، تأیید صحت اطلاعات یا Verification است. در این بخش، کاربر باید صحت تمامی حقایق، ارقام و ادعاهای کلیدی را با استفاده از منابع مستقل و معتبر بررسی کند. اگر AI منابعی ذکر کرده باشد، اعتبار و وجود واقعی آن منابع باید تأیید شود و در صورت عدم ذکر منبع، کاربر مسئول است که با جستجوی دقیق، صحت دادهها را بررسی کند تا از پدیده Halucination جلوگیری شود. علاوه بر این، متن باید با دانش، اسناد و سیاستهای داخلی سازمان یا تخصص فردی بازبین، مقایسه و تأیید شود. ستون دوم، تحلیل فراتر از متن (Beyond Text Analysis) است. این تحلیل شامل ارزیابی منطق و استدلال AI است؛ کاربر باید نه تنها به نتیجهگیری نهایی، بلکه به مسیر استدلالی که AI طی کرده توجه کند تا از اعتبار مفروضات اطمینان یابد. همچنین، شناسایی ریسکهای پنهان، مانند احتمال سوءتفاهم، انتشار شایعه یا پیامدهای منفی اخلاقی، ضروری است. در نهایت، کاربر باید نقاط ضعف و اطلاعات از قلم افتاده (Gaps) را که AI به دلیل محدودیت دادههای آموزشی نتوانسته است پوشش دهد، شناسایی کرده و آنها را بهصورت دستی اضافه نماید. این فاز اطمینان میدهد که خروجی نهایی، نهتنها از نظر اطلاعاتی صحیح است، بلکه از نظر منطقی مستحکم، مسئولانه و کاملاً جامع است.

فاز چهارم Model یا حلقه آخر مدل

(تکمیل کننده): نهادینهسازی و بهبود مستمر

فاز مدل، در حقیقت بهمعنای بسته شدن حلقه و مدیریت مدل است؛ این فاز به عنوان فاز نهایی مدل ICAM، وظیفه نهادینهسازی کامل فرآیندهای چهارگانه در جریان کار روزمره و ایجاد یک چرخه بازخورد مستمر برای تضمین پایداری و بهبود کیفیت را بر عهده دارد. این مرحله، استفاده از هوش مصنوعی را از یک ابزار موقتی یا اختیاری، به یک قابلیت استراتژیک و یکپارچه در سطح سازمان یا فرآیند کاربری تبدیل میکند. در ابتدا، باید بر تولید الگوها و استانداردسازی تمرکز شود. موفقترین فرمانها (Prompts)، لایههای بومیسازی و روشهای بازبینی که در فازهای قبلی عملکرد بالایی داشتهاند، باید جمعآوری و به صورت کتابچه راهنما یا بانک فرمانهای داخلی مستند شوند. این اقدام، یکنواختی کیفیت و افزایش کارایی را در تمامی بخشهای سازمان تضمین میکند. در ادامه، ایجاد حلقههای بازخورد و آموزش رسمی حیاتی است. دادههای مربوط به خطاها، Halucinationها، یا سوگیریهای کشف شده در فازهای انتقادی و تطبیق، باید به دقت ثبت شوند. این دادهها بلافاصله برای بازآموزی تیمها (تقویت مهارتهای فاز Intelligent) و تنظیم دقیقتر دستورالعملهای داخلی برای استفاده از AI استفاده میشوند. همچنین، مدیریت ریسک و مستندسازی فرآیند، یک ضرورت است. سوابق بازبینی ICAM برای محتوای حساس باید حفظ شود تا مشخص گردد چه کسی و با چه معیارهایی خروجی AI را تأیید کرده است. این مستندسازی در مواجهه با چالشهای حقوقی یا اخلاقی آینده، مسئولیتپذیری را شفاف میسازد. نهایتاً، نظارت بر عملکرد (Monitoring) پیوسته مدلهای AI برای تشخیص تغییرات کیفی (مانند Drift) یا کاهش ناگهانی دقت در اثر بهروزرسانیها، تضمین میکند که ICAM به یک سیستم زنده و پویا تبدیل شود و سازمان بتواند با سرعت تحول تکنولوژی AI همگام باقی بماند.

- فاز اول:آموزش و آگاه سازی

- فاز دوم:تولید و مستندسازی

- فاز سوم:تأیید و تحلیل انتقادی

- فاز چهارم:طرح مشوق و بهبود مستمر

از دستیار کور تا شریک استراتژیک:

نقش هوش مصنوعی با مدل ICAM

مدل ICAM که مخفف Intelligent, Critical, Adaptation, Management است، یک نقشه راه عملیاتی برای گذار سازمانها از یک بهرهبرداری ساده و خام از هوش مصنوعی مولد به استفاده از آن در جایگاه یک شریک استراتژیک و هوشمند خواهد بود. در شیوه رایج و ابتدایی استفاده، هوش مصنوعی عملاً مانند یک “دستیار کور” (دستیاری که درکی از شرایط فرهنگی، اجتماعی، اقتصادی و… حاکم بر ایران یا حتی شهر محل استقرار کارشناس ندارد) عمل میکند؛ ابزاری که محتوا را با سرعت بالایی تولید میکند اما فاقد هرگونه درکی از درستی اطلاعات، بافت فرهنگی یا پیامدهای استراتژیک متن است و کاربران نیز به دلیل همین سرعت، خروجی آن را بهصورت کورکورانه میپذیرند. این وابستگی غیرانتقادی، ریسکهای جدی مانند نرخ بالای Halucination، سوگیریهای فرهنگی ناخواسته و عدم انطباق با مقررات محلی را به همراه دارد که مانع از کاربرد هوش مصنوعی در محیطهای حساس و تصمیمگیریهای کلیدی میشود. مدل ICAM با ارائه چهار فاز متوالی، ماهیت این رابطه را دگرگون میسازد. در این مدل، تأکید فلسفی بر اولویت دادن به صحت بر سرعت است و این تحول از طریق توانمندسازی کاربر انسانی بهعنوان ناظر، مربی و عنصر کنترلی هوشمند محقق میشود.

برای روشن شدن این فرآیند، یک شرکت بزرگ تولید مواد غذایی در ایران را در نظر بگیرید که میخواهد برای معرفی یک محصول جدید، کمپین تبلیغاتی در شبکههای اجتماعی اجرا کند و از هوش مصنوعی برای نگارش محتوای اولیه بهره میبرد. در فاز Intelligent یا هوشمندانه، تیم محتوا ابتدا آموزش میبیند که خروجی AI صرفاً یک پیشنویس است و با استفاده از مهندسی فرمان، از AI میخواهند که لحنی رسمی و متناسب با فرهنگ غذایی ایرانی و حساسیتهای محلی اتخاذ کند. سپس در فاز Adaptation (تطبیق)، محتوای خام AI که ممکن است ارجاعات غربی یا ناهمسو داشته باشد، بهطور فعال بازنویسی میشود؛ تمامی مثالها و استعارهها به مفاهیم و سبک زندگی بومی تبدیل میشوند تا از نظر فرهنگی کاملاً مقبول و مؤثر باشد و با مقررات اجتماعی-فرهنگی داخلی همخوانی داشته باشد. در فاز Critical (انتقادی)، تیم، صحت تمامی ادعاهای مربوط به محصول (مانند درصد مواد مغذی یا تأییدیههای بهداشتی) را با اسناد فنی معتبر داخلی تأیید کرده و همچنین، پتانسیل سوءتعبیر یا ریسکهای اجتماعی محتوا را پیش از انتشار، بهطور دقیق تحلیل میکند تا هیچ ابهام یا آسیبی ایجاد نشود (تحلیل فراتر از متن). نهایتاً در فاز MODEL (مدیریت مدل)،تمامی فرمانهای موفق، لایههای تطبیق و چکلیستهای انتقادی در یک مستند داخلی ثبت و استانداردسازی میشوند تا تمامی کمپینهای آتی با همین سطح از دقت، اعتبار و همسویی فرهنگی اجرا شوند و یک چرخه بهبود مستمر فعال بماند. با اجرای مدل ICAM، خروجی هوش مصنوعی از یک متن خام پرریسک به یک محتوای بومی، تأییدشده، دقیق و استراتژیک تبدیل میشود؛ در نتیجه، هوش مصنوعی از یک دستیار سریع اما کور، به یک شریک استراتژیک و قابل اعتماد در فرآیندهای حیاتی سازمان ارتقا پیدا میکند.